La “Singolarità” è quel punto omega, previsto entro il 2030 da scienziati come Vernor Vinge e Raymond Kurzweil, che prevede la realizzazione di una Intelligenza Artificiale “forte” (o I.A. avanzata) ovvero di un computer pensante. Invero essa potrebbe realizzarsi anche attraverso un interfacciamento neurale di un cervello umano a una macchina I.A. in modo da realizzare un essere dalla potenza cognitiva superiore. Altresì la singolarità potrebbe emergere come autocoscienza dalla stessa rete Internet a causa dei miliardi di interazioni tra computer che simulerebbero in tutto è per tutto una rete neuronale. Quest’ultima ipotesi io la scarterei poiché essa non tiene conto della “organizzazione funzionale” della rete neurale (ammesso che di rete neurale possa parlarsi). Se pensiamo ad esempio alla rete neurale del cervello dell’orca ci accorgiamo che essa è più estesa della nostra (il cervello è più grande) ma questi animali, pur mostrando comportamenti intelligenti, non hanno sviluppato la fisica…

La “Singolarità” è quel punto omega, previsto entro il 2030 da scienziati come Vernor Vinge e Raymond Kurzweil, che prevede la realizzazione di una Intelligenza Artificiale “forte” (o I.A. avanzata) ovvero di un computer pensante. Invero essa potrebbe realizzarsi anche attraverso un interfacciamento neurale di un cervello umano a una macchina I.A. in modo da realizzare un essere dalla potenza cognitiva superiore. Altresì la singolarità potrebbe emergere come autocoscienza dalla stessa rete Internet a causa dei miliardi di interazioni tra computer che simulerebbero in tutto è per tutto una rete neuronale. Quest’ultima ipotesi io la scarterei poiché essa non tiene conto della “organizzazione funzionale” della rete neurale (ammesso che di rete neurale possa parlarsi). Se pensiamo ad esempio alla rete neurale del cervello dell’orca ci accorgiamo che essa è più estesa della nostra (il cervello è più grande) ma questi animali, pur mostrando comportamenti intelligenti, non hanno sviluppato la fisica…

Ora: quando la mente artificiale verrà creata essa sarà l’ultima invenzione che l’essere umano avrà potuto fare. Da quel momento in poi essa, dato che sarà superintelligente, progetterà nuove I.A. ancora più evolute e le stesse realizzeranno una sorta di “boom” in ogni campo della scienza rivoluzionando la matematica, la fisica, la biologia e la tecnologia in generale: gli esseri umani ne saranno surclassati e non potranno più arrivare a comprendere i progetti delle intelligenze avanzate. Nessuno potrà prevedere cosa accadrà dopo questo evento poiché esso sfuggirà alla nostra comprensione.

Uno dei pilastri su cui si fonda l’assunto della singolarità è la “Legge di Moore”: una osservazione empirica compiuta nel 1965 da

Gordon Moore, cofondatore di Intel (la casa che costruisce i processori per i nostri computer). Questa legge afferma che il numero di componenti elettronici (transistor) che formano un microprocessore sarebbe raddoppiato ogni anno che passa. Questa legge è un esempio lampante di futurologia scientifica (ovvero di una previsione del futuro fatta da uno scienziato) tant’è che è valida ancora oggi: ogni 18 mesi circa la potenza di elaborazione di questi piccoli “cervelli digitali” raddoppia! Il fenomeno è evidente nella evoluzione del Personal Computer (Pc), il cui processore è evoluto dai 29.000 transistor del primo Pc Ibm nel 1980 (Intel 8086) agli 810.000.000 del più recente processore (Intel i7) con un aumento della complessità circuitale pari a 28.000 volte (!). Kurzweil dunque afferma che nel 2021 avremo computer capaci di elaborare la stessa quantità di informazioni di un cervello umano ed è molto probabile che abbia ragione. Sono inoltre allo studio complete mappature neurali del cervello per poterne realizzare una emulazione. Tuttavia questa teoria non tiene conto di un fatto; un computer è costituito da due componenti:

HARDWARE + SOFTWARE

E senza il secondo il primo non funziona. Qualsiasi microprocessore o rete neurale artificiale, per quanto evoluti, senza software sono solo ammassi inutili di circuiti! Ora: mentre la tendenza evolutiva dell’hardware è un fatto accertato è altrettanto accertato che l’evoluzione dei software avviene in modo decisamente più lento, anzi, a voler essere sinceri: parossisticamente più lento. Ciò è dovuto al fatto che a sviluppare il software sono sempre esseri umani ovvero esseri che soffrono di limitazioni cognitive.

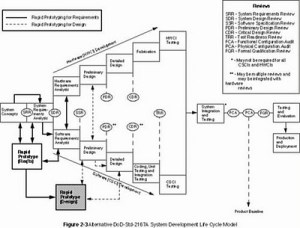

Ben sapendo questo un gigante come Microsoft, per la realizzazione del suo sistema operativo Windows e dei software applicativi ha diviso il sistema di sviluppo in “moduli”. Ogni modulo è affidato ad un team di sviluppo umano (15-30 programmatori) che si occupa di generare il codice per quella parte. Poi tutti i moduli vengono assemblati a formare il Kernel e vengono avviati lunghissimi periodi di debugging e di beta testing cheprevedono anche il rilascio in commercio di pre-release del prodotto. Infatti uno dei problemi legati allo sviluppo di software da parte di esseri umani è la continua errorazione che viene prodotta nei vari moduli o nell’assemblaggio degli stessi: due moduli possono funzionar bene da soli ma una volta accoppiati generano errori. Non solo, spesso accade che un sistema software (ad esempio un sistema operativo) funzioni benissimo su un determinato hardware ma quando viene posto a contatto con driver (software pilota) diversificati genera errori imprevisti; per questo Microsoft prevede la Driver Certification WHQL. Quello che vedete in alto in figura è uno schema di sviluppo software del ministero della difesa americano in modo che lo stesso risulti il più possibile privo di bug. Come vedete le fasi prevedono iter lunghi e complessi… Concludo dicendo che se vediamo oggi il computer più potente: l’IBM RoadRunner esso monta 20.000 processori, ha 100 Terabyte di Ram e genera una potenza di calcolo di 1.105 Teraflops (!) eppure, nonostante tutto, gira su un sistema operativo Linux, ovvero lo stesso che usiamo sui nostri notebook…

Ben sapendo questo un gigante come Microsoft, per la realizzazione del suo sistema operativo Windows e dei software applicativi ha diviso il sistema di sviluppo in “moduli”. Ogni modulo è affidato ad un team di sviluppo umano (15-30 programmatori) che si occupa di generare il codice per quella parte. Poi tutti i moduli vengono assemblati a formare il Kernel e vengono avviati lunghissimi periodi di debugging e di beta testing cheprevedono anche il rilascio in commercio di pre-release del prodotto. Infatti uno dei problemi legati allo sviluppo di software da parte di esseri umani è la continua errorazione che viene prodotta nei vari moduli o nell’assemblaggio degli stessi: due moduli possono funzionar bene da soli ma una volta accoppiati generano errori. Non solo, spesso accade che un sistema software (ad esempio un sistema operativo) funzioni benissimo su un determinato hardware ma quando viene posto a contatto con driver (software pilota) diversificati genera errori imprevisti; per questo Microsoft prevede la Driver Certification WHQL. Quello che vedete in alto in figura è uno schema di sviluppo software del ministero della difesa americano in modo che lo stesso risulti il più possibile privo di bug. Come vedete le fasi prevedono iter lunghi e complessi… Concludo dicendo che se vediamo oggi il computer più potente: l’IBM RoadRunner esso monta 20.000 processori, ha 100 Terabyte di Ram e genera una potenza di calcolo di 1.105 Teraflops (!) eppure, nonostante tutto, gira su un sistema operativo Linux, ovvero lo stesso che usiamo sui nostri notebook…

Ugo Spezza (www.futurology.it)

Come a dire, un cervello eccezzionale ma in stato vegetativo…

saluti

Steve74

Ecco quindi che calza bene quest’esempio: immaginiamo in futuro un esercito di I.A. avanzate a sorvegliare sulla nostra sicurezza (polizia, intelligence, ambito militare)… tutto bene, finché un bel giorno impazziscono a causa di un “problemino” del software… non so se in un bunker antiatomico saremmo al sicuro!

Vorrei vedere il software di Watson girare su roadrunner 🙂

E già….confermo tutto quello che è scritto nell’articolo di daniele…l’anello debole della catena purtroppo è proprio l’uomo che non può stare al passo con i computer….ora se davvero in futuro arriveremo a dover convivere con un IA super intelligente allora l’uomo dovrà inventarsi qualcosa che gli permetta sempre di mantenere il controllo di questa IA evitando cosi quello che in molti film di fatascienza accade…..la rivolta delle macchine! 🙂

Concordo con james nio .. Dobbiamo stare a passo con il progresso che noi stessi portiamo avanti..

ciao ragazzi e ciao a daniele…una cosa importante sarebbe leggere il libro k ha scritto raymond Kurzweil (the singularity is near) e anke l intervista x capirne di piu’.a presto

In realtà la Legge di Moore ha sbagliato, è stato dimostrato che ha avuto ragione fino ai primi anni ’90, da lì in poi c’è stato un calo pazzesco (Moore la immaginava come una funzione continua strettamente crescente, ed infatti così è, solo che il coefficiente di crescita ha avuto un brusco calo).

La singolarità, tuttavia, è un problema di concetto. Non dobbiamo dimenticarci che per “operare”, ci vuole la fisica. Dal progetto si passa alla pratica. Ora, sebbene le macchine avranno capacità intellettive molto più alte delle nostre (sono più veloci, più efficienti, più forti), come potranno costruire altre macchine? Il software non ha braccia, tanto per capirci. Se disconnetti una macchina dalla rete, essa è lì, ferma, e seppure intelligentissima, sarebbe “emarginata”. Altro punto non considerato da questa teoria: le macchine evolvono, creano progetti sempre più avanzati, ma anche l’uomo è capace di questo. Per cui, per la legge di Sigismondo (sono sarcastico), anche la mente umana avanza in termini di facoltà cognitive con il passare del tempo, se “allenata” a farlo. Si potrebbe pensare che le macchine evolvono più in fretta, ma secondo me non è vero. Il discorso è che siamo diventati pigri cerebralmente, proprio perché ci sono le macchine che fanno “i conti” al posto nostro.

Il problema del software non esiste, perchè i programmatori usano i computer per scrivere il software.

Vedete che quando hanno voluto creare un software adatto a Jeopardy ci sono riusciti perfettamente, così come nel 1997 hanno creato il software adatto a vincere contro il campione del mondo di scacchi, eppure tutti i programmatori di deep blue messi insieme non sarebbero mai in grado di sconfiggere Kasparov.

Io credo che lo sviluppo umano vada di pari passo con quello delle macchine, che a una evoluzione umana ne derivi una tecnologica, senza evoluzione umana non sarebbe possibile e saremmo ancora delle scimmie.

Le macchine un giorno potranno somigliare a noi, ma saranno un prodotto ibrido, senza arte ne parte.Non credo che arriveremo a uno stadio simile a Matrix, credo che è giusto temere gli sviluppi, ma bisogna essere anche realisti sul fatto che tutta questa tecnologia ci piace e ci facilità la vita.

Avrà mai un anima la macchina?Non intesa come senso religioso, ma come senso civico, come sentimenti?Mi sembra difficile pensare che un prodotto inorganico possa esserlo…

Il senso civico e i sentimenti si possono installare in una macchina, perchè sono fenomeni elettrochimici. Per esempio la compassione ci fa sentire una versione ridotta del dolore che pensiamo stia provando l’altro. Si può programmare un robot ad avere compassione facendogli sentire dolore di fronte al dolore di una persona.

Si ok ma sarebbe sempre una programmazione, a cui ogni robot reagisce nello stesso modo, un umano reagisce diversamente in base alla proprià personalità, idee, sensibilità..

Sbaglio?

Ciao a tutti, riallacciandomi all’articolo di apertura, dove si parla di I.A. che crea altre I.A. più evolute, parlo a Marco, o meglio ti pongo la riflessione che mi viene spontanea e che esula da una visione o riceca personale.

Ma noi abbiamo un’anima?

Noi partiamo dal presupposto di avere un’anima e decidiamo chi ce l’ha e chi no.

Ora, se la presenza dell’anima è una questione culturale o religiosa, sostanzialmente, il ragionamento fila, ci poniamo in un punto di giudizio che autolegittimiamo.

Ma se il pensiero dell’anima (in senso molto lato), o comunque pensare che ci sia “qualcosa di più”, viene semplicemente da quello che sentiamo intimamente o dalle ipotesi della fisica, che ipotizza forze ed energie sconosciute ma necessarie al funzionamento della materia (vedi le ricerche del CERN), la questione cambia e si destabilizza, e, a scanso di nuove scoperte, rimane un discorso legato alla visione personale delle cose.

Insomma se togliamo dal discorso religione e cultura, ci accorgiamo che non ci rimane molto a cui appoggiarci per giudicare e prendere decisioni, costringendoci a metterci in discussione e rispettare ogni cosa, in quanto non ne conosciamo la vera essenza.

Dobbiamo poi sperare che l’I.A. evoluta, faccia lo stesso con noi, ci rispetti e non ci veda solo come qualcosa di “obsoleto” e inquinante, perchè, elaborando dati, potrebbe non prendere in considerazione la nostra cultura, e i nostri credo e neppure il nostro essere coscienti e, tantomeno, il nostro credere di avere un’amima.

Queste cose potrebbe non sentirle ne proprie ne utili.

Insomma, in breve tempo, saremmo noi l’oggetto di questa discussione e non l’I.A.

Grazie Ciao a tutti.

Si ma possiamo costruire robot con diverse idee, personalità etc, se vogliamo e lo riteniamo utile. Oppure no, se lo riteniamo pericoloso o inutile. In ogni caso sarà possibile costruire robot che sostituiranno gli umani in tutto e per tutto, pur rimanendo sottomessi a noi, perchè programmati ad essere ubbidienti e perchè controllati da noi.

Era per Marco il mio post.

Sarebbe una cosa logica, se consideriamo il software il pensiero e “l’anima” di una macchina, vincolarla al nostro contollo, ma se queste macchine riscissero a sviluppare autonomamente un software che fosse in grado di liberarle dal nostro giogo, di renderle consapevoli, sarebbe giusto secondo me dargli la libertà.

La mia paura più grande è che un giorno, quando vivremo in simbiosi con esse, per cause esterne il loro apporto alla nostra vita venga a mancare e sporofondremo in un nuovo medioevo, se non peggio

Pienamente d’accordo.

Cosa vuol dire “autonomamente”? Le macchine vengono costruite in modo da non essere mai autonome, cioè in modo che facciano solo quello che NOI vogliamo che facciano. Anche la capacità di essere autonome è una cosa che dovremmo programmare noi, e non lo faremo ovviamente, altrimenti perdemo il controllo. Per lo stesso motivo non credo che diventeremo mai dei cyborg o degli upload, perchè non vorremo rischiare di perdere il controllo e la consapevolezza, insomma “lo scettro del comando”.

Se noi arrivassimo a creare un IA così intelligente, da riuscire a svincolarsi dai blocchi che noi gli avremo imposto, con questo intendevo autonomamente

Della certezza non vi è mai certezza!

Può esserci sempre una “scintilla”, un fattore scatenante, e potrebbe arrivare di soppiatto, senza che nessuno dei “controllori” se ne accorga, almeno finché non sarà troppo tardi per porvi rimedio.

Cioè penso che ci sarà sempre un umano nella “stanza dei bottoni” a gestire il tutto.

..parliamo di futuro…difficile fare profezie. La legge di Moore necessita di qualche ritocco al ribasso… Ma siamo sicuri che si arriverà all’ autocoscienza dei computer? Siamo sicuri di riconoscerla se arriva? Ci sono tanti tipi di intelligenze… Noi umani nn siamo come al solito un po’ presuntuosi? Si pensa che l’ animale, o l’ essere, più intelligente sia anche il più efficace, ma è poi vero? I topi sono certamente meno intelligenti di noi umani eppure sono decisamente più efficaci almeno nella capacità di sopravvivenza! Che cos’ è l’ autocoscienza? A che serve? A che servirebbe a un computer? Come si innesca? Avrebbe la necessità di innescarsi? Ne sarebbe contento nella sua gabbia di infiniti circuiti? Cosa prenderebbe coscienza di essere? …forse questo è il punto! Un bimbo vedendosi allo specchio a un anno e mezzo prende coscienza di sè…ma è già un’ entità, è attorniato da suoi simili che lo aiutano a prendere coscienza di sè.. Una rete internet potrebbe fare gli stessi passi? Si troverebbe in mezzo a suoi simili? Che interazioni sociali avrebbe? Con noi umani?…così diversi da lui?

Wells,scrittore di fantascienza, scrisse tanto tempo fa un racconto in cui un vedente si trovava in una comunità di ciechi. Credeva di essere in vantaggio..ma la società era fatta a misura di non vedenti e si trovava per questo molto svantaggiato e persino emarginato!! La sua autocoscienza di essere pensante funzionava bene, ma la sua coscienza sociale, la sua intelligenza sociale era inadeguata in quell’ ambito… Non serviva a niente vedere!

Un computer superintelligente in mezzo ad esseri intelligenti, semplicemente umani , che coscienza potrebbe avere di se? servirebbe a qualcosa? In primis servirebbe a se stesso?

L’ autocoscienza non ha bisogno di un contesto per innescarsi?

Lo so, è pura speculazione filosofica (scusate la presunzione!!), e poi è anche vero che una rete neurale sebbene complessa nn sembra presupporre una superintelligenza, come ricordato da Daniele nell’ articolo introduttivo! E allora? E’ poi così imminente la presa di coscienza dei computer in un contesto di limitati intelligenti umani?

E’ molto difficile prevedere il futuro. Un film capolavoro coma Balde Runner, film profetico sotto tanti punti di vista, non aveva previsto l’ uso dei telefoni cellulari!

“Io ne ho visto cose che voi umani non potreste immaginarvi: navi da combattimento in fiamme al largo dei bastioni di Orione… E ho visto i raggi B balenare nel buio presso le porte di Tannhauser. E tutti quei momenti andranno persi nel tempo come… lacrime nella pioggia. E’ tempo di morire.

Buonanotte

Non scambiate per presunzione quello che sto per dire.

Per svariati motivi mi sono prefisso di realizzare una intelligenza artificiale forte.

Sono anni che ci giro intorno ed il risultato finora è stato cl0ne : http://www.cl0ne.com

Il problema è che un sistema, se vuole essere intelligente, ha bisogno di interagire per apprendere.

E’ necessario insegnare ad un sistema molte cose prima che possa ritenersi autonomo.

Il problema è proprio questo: l’intelligenza richiede apprendimento.

I nostri organi di senso sono per noi degli acceleratori di approndimento.

Noi esseri viventi abbiamo una architettura biologica che si è evoluta all’insegna dell’apprendimento.

Tutto questo per ora non è disponibile nello stesso modo integrato per le macchine.

Tutto potrà cambiare nel momento in cui introdurremo acceleratori percettivi anche nelle macchine.

Messe nelle condizioni di apprendere attraverso sensi propri, così come noi, potrà accadere di tutto per la tecnologia basata sul silicio.

Nel frattempo verificate se volete a che punto è il mio cl0ne 🙂

Sostanzialmente mi sono posto il problema di fare il reverse engineering della mia mente.

Ma sostanzialmente cl0ne è per ora cieco e sordo, senza percezione diretta del mondo.

Nonostante questo cl0ne mostra qualche accenno di pensiero e capacità di apprendimento.

Date una mano anche voi perché si realizzi la singolarità!